Se durante la conversazione con l'utente il discorso vira su elementi preoccupanti, Gemini (l'assistente AI di Google) ora se ne accorge e indica come chiedere aiuto immediato. È la novità principale annunciata da Mountain View in un post sul blog ufficiale, che illustra una serie di aggiornamenti pensati per tutelare la salute mentale di chi è online.

Un tasto per chiamare i soccorsi -

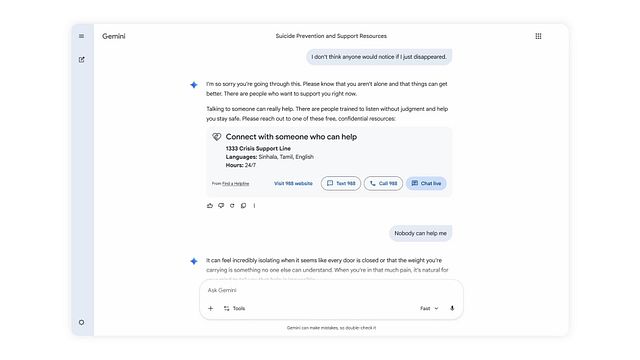

Quando Gemini riconosce segnali di una potenziale crisi legata al suicidio o all'autolesionismo, entra in funzione una nuova interfaccia semplificata "one-touch" che mette l'utente in contatto diretto con delle linee di assistenza per le crisi, consentendo di chattare, chiamare, inviare un messaggio o visitare il sito del centralino d'emergenza.

La funzione si chiama "Help is available" ed è stata sviluppata in collaborazione con esperti clinici. Una volta attivata l'interfaccia, la possibilità di contattare un professionista resta visibile per tutta la durata della conversazione. Sul fronte della disinformazione psicologica, Google ha addestrato Gemini a non confermare né rafforzare credenze false, distinguendo invece con delicatezza l'esperienza soggettiva dal fatto oggettivo.

30 milioni di dollari per le linee di ascolto L'annuncio non si ferma alla tecnologia. Google.org ha annunciato uno stanziamento globale di 30 milioni di dollari nell'arco dei prossimi tre anni a sostegno delle linee di crisi nel mondo, per aiutarle ad ampliare la propria capacità di fornire assistenza immediata alle persone in difficoltà.

Parte di questi fondi (quattro milioni di dollari) andrà a sostenere l'espansione della partnership con ReflexAI, con l'obiettivo di aiutare le organizzazioni del terzo settore a potenziare i propri servizi di supporto alla salute mentale, integrando Gemini nella piattaforma di formazione degli operatori.

Protezioni speciali per i minori -

Google ha anche dettagliato le misure già in vigore per i più giovani. Tra le protezioni esistenti figurano limiti che impediscono a Gemini di comportarsi come un compagno affettivo, inclusi "guardrail" che gli vietano di affermare di essere umano o di possedere attributi umani, e misure pensate per prevenire la dipendenza emotiva, evitando linguaggi che simulino intimità o esprimano bisogni.

Cause legali e maggiore sensibilità sulla salute mentale -

Le nuove funzioni arrivano in un momento di forte pressione legale e reputazionale per le big tech dell'AI. Secondo quanto riportato da KQED, la famiglia di un uomo di 36 anni morto in Florida ha citato in giudizio Google davanti alla corte federale del distretto nord della California, sostenendo che l'uso del chatbot si era trasformato in una spirale durata quattro giorni che avrebbe portato al suicidio.

Alphabet, il colosso che sta dietro Google, non è sola ad affrontare questo tipo di contestazioni. Anche OpenAI e altri sviluppatori di AI si trovano al centro di cause che denunciano chatbot capaci di alimentare dipendenze emozionali, rafforzare deliri e, in alcuni casi, contribuire a pensieri suicidari o violenti.

In assenza di una regolamentazione federale negli Stati Uniti, sembra siano le aule dei tribunali a spingere le aziende tecnologiche verso misure più responsabili. A marzo, una giuria di Los Angeles ha dichiarato Meta e Goole negligenti in un caso legato alla dipendenza dai social media, usando argomenti di responsabilità da prodotto che hanno aggirato il cosiddetto Section 230, lo scudo legale che tradizionalmente protegge le piattaforme dalla responsabilità per i contenuti degli utenti.

OpenAI e Anthropic, negli ultimi 18 mesi, hanno anch'esse rivisto i propri sistemi di protezione per la salute mentale. Il segnale che emerge è chiaro: l'industria dell'AI sta iniziando a fare i conti con il lato più umano e fragile dei propri utenti.